pappaq

-

Posts

210 -

Joined

-

Last visited

Content Type

Profiles

Forums

Downloads

Store

Gallery

Bug Reports

Documentation

Landing

Posts posted by pappaq

-

-

Ich habe seit dem Flash auf die neue Version eine Erhöhung des Stromverbrauchs des Servers um 3 Watt im Idle. Ist das hier auch schon jemand anderem passiert?

-

Danke, dann werde ich es zunächst auch erstmal mit der Version probieren dieses WE.

-

On 4/3/2024 at 7:55 PM, LtCMDstone said:

Ach kein Ding!

Hehe ja nachbauen ist relativ 😁 hatte das Board schon und dann durch Zufall gesehen das du im Prinzip das selbe Board nutzt da kam mir der Thread gut gelegen 😆

Das gute ist das Problem mit dem nicht erkannten Controller/Platten scheint die "alte" Firmware die alle geflasht haben scheinbar gelöst, seit ich die drauf hab habe ich das Problem nicht mehr.

Der Controller steckt jetzt im zweiten PCIe.

Bin aber trotz allem momentan Recht zufrieden, mit Array und 24 Dockern hab ich im idle 28-32W

Das ist bei weitem besser als ohne Optimierung 😁

Nur das mit der 2.5G NIC und ASPM fuchst mich etwas 😆

Welches ROM hast du geflasht? 11080000.ROM oder 11180000.ROM?

-

On 3/21/2024 at 10:05 AM, LtCMDstone said:

Sooo zuallererst einmal vielen Dank!

Hab es bis jetzt zumindest im Idle auf C3 80% geschafft wo ich vorher überhaupt kein C-State erreicht habe! Und immerhin C2 60% wenn alle Dockers laufen.

Extra von einer LSI auf eine ASM1166 gewechselt (die hat momentan nur Probleme das die Karte erkannt, aber die Platten die dran hängen ab und an beim reboot nicht erkannt werden, mal ja mal nein). Firmware muss ich noch nachschauen, hab momentan keinen Windows PC zur Hand.

Jetzt aber mein "Problem" selbst mit ausgebauter ASM Karte und ohne meiner Cache NVME (Pro 980) komme ich nicht weiter runter, wie kann ich hier weiter schauen was der Auslöser ist?

ASPM ist überall enabled.

Board hab ich den "großen" DDR5 Bruder von deinem, das Gigabyte B760 Gaming X AX dazu

i7 12700

2x Kingston Fury 8GB (wie kann man in Linux die dämlichen LEDs ausschalten)

2x Corsair Vengeance 32GB

Hoffe auf 1 2 3 gute Tipps wie ich da weiter kommen kann 🙂

Moin, entschuldige, dass ich jetzt erst wieder hier reinschaue. Ich habe die Notifications aus gemacht für das Forum hier. Freut mich aber, dass du meinen Build nachbauen konntest.

Ich habe inzwischen ein ähnliches Problem mit den Controllern. Ich konnte noch nicht einkreisen, welcher von den beiden dafür sorgt, dass HDDs nicht mehr erkannt werden beim Neustart, aber ich denke auch weitere ioWait etc. Probleme werden bei mir davon ausgelöst. Bin gerade bei der Fehleraufnahme.

Zu deinem ASPM Problem: Auf dem Screenshot kann ich auf Anhieb nichts erkennen, das bei mir anders aussähe. Welche PCIe Slots hast du denn nun im Gebrauch?

-

Scrubbed the pool again and the errors are gone, for now...the scrub speed was very good though.

The speed is slow anyways and the iowait is super high when there is traffic on the zpool...

-

I've noticed data corruption on the ZFS pool but where did you see the corruption for the BTRFS pool? In the UI it does not show any errors.

I will run memtest as soon as I've got the time for it...the system is completely new 😑

-

Hello everyone, I have the following problem: All copy or write operations to and from the encrypted formatted ZFS cache pool are incredibly slow. Maximum 60MB/s. Even, as you can see in this screenshot, when I copy from SSD to SSD. The IOwait is then also high.

I would like to stay with ZFS because of the storage efficiency, but the speed is ridiculous. I've read about a problem of Unraid when using ZFS for the array itself but not when using it for pools.

Could someone give me a hint?

Thanks in advance!

-

I've changed my backup jobs to drive shares. Currently the smb is responsive as it backups...so that seems like a win. Lets see, if I can streamline the usage of the array around this circumstance. Thanks @JorgeB

-

1

1

-

-

Had to hardreset the system. Changed the RAM but no change at all. When a backup from my workstation is running, the system becomes unresponsive smb wise...

I have read many iowait issues unraid related in the past 6 month. Is there anything that can be done about this?

-

Even a poweroff -f command doesn't bother the system as it runs the mover command...I cannot reboot, shutdown or stop the mover process, even shell telling me it is not running anymore. Feels like complete randomness.

-

And it's happening again. VMs are disabled completely, I've managed to disable the docker service as well when it happened...nothing changed. As if unraid is busy with itself.

When I try to get the diagnostics, the process hangs at collecting the zfs info:

I've then tried to stop the array. But it does not work, the gui indicates, that it is running...

But it isn't anymore:

New RAM is on its way. Could it be something else? Diagnostics via shell is also not possible.

-

How can that happen? After rebooting the flash drive is up and running again. I've changed the flashdrive just some month ago and it is a Samsung one, that is recommended by Spaceinvaderone...

These problems are getting so annoying.

-

Hey there,

my server is again acting weird.

The CPU goes up to 100% and it locks up during that time. After it is reachable again the UI does weird stuff like showing the drives of the array as mountable and such...

Could someone please take a look? I thought I've found the issues of the system, by:

- exchanging the Ryzen system for a complete Intel i3 System

- exchanging the older controllers for new ones.

The only thing that's the same as before is RAM, USB Stick and the SSDs and HDDs...

Weird as well is, that the created diagnostics are named "tower" and not like the server should be named.

-

I've changed my whole system from Ryzen to Intel and switched all old controllers to new ASM1166. All iowait issues are gone now. So I assume it had something to do with it.

-

1

1

-

-

On 12/13/2023 at 6:50 AM, BigChris said:

Was haltet ihr von den Seagate Exos Festplatten?

18TB für 199€?

Schnapper oder doof?

Ich persönlich halte nicht so viel von teuren NAS Platten im Privatbereich, wo die Platten die meiste Zeit schlafen.

Wo hast du denn 18TB für 199€ gefunden?

-

22 minutes ago, MPC561 said:

Danke! Das hat sofort geklappt!

Jetzt muss ich nur noch testen, auf welchen Anschluss ich alle Lüfter gesteckt habe und ob sie dann auch abhänging davon drehen

-

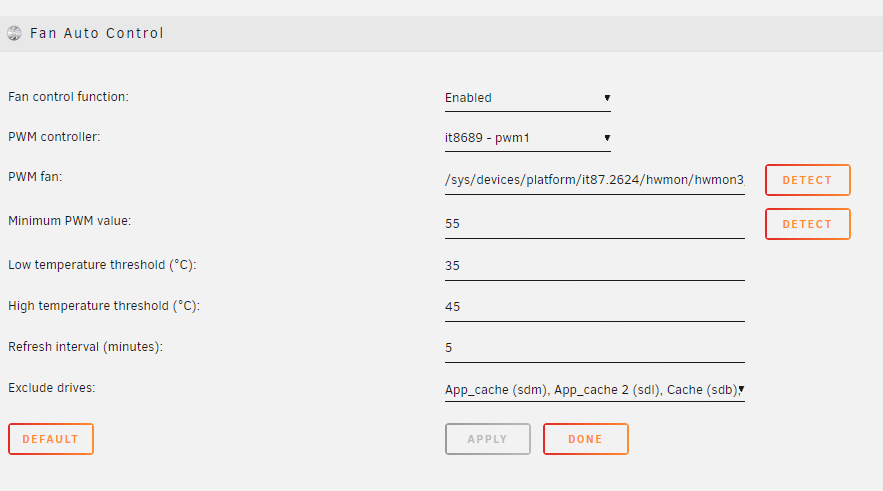

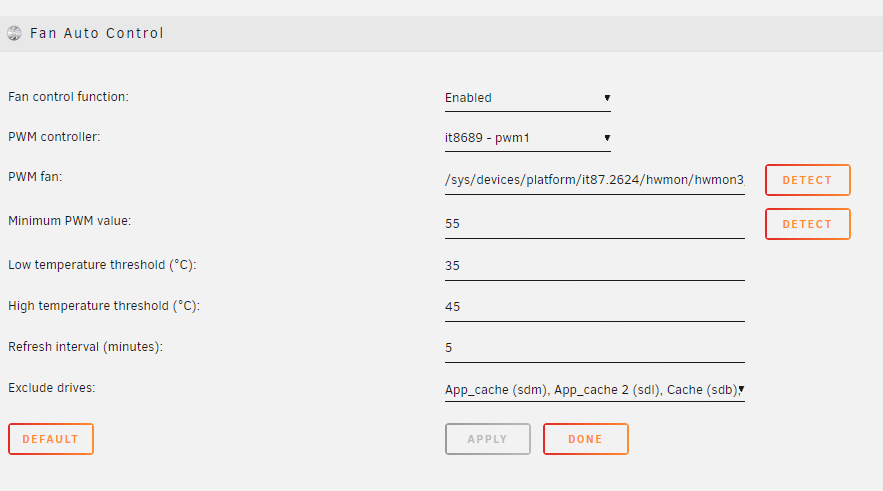

41 minutes ago, faxxe71 said:

Guten Morgen,

hat jemand an diesem Board die PWM Lüfter Kontrolle mittels Dynamix System Autofan Plugin in Betrieb nehmen können?

Ich sehe zwar die Drehzahlen aber die Regelung funktioniert nie.

Danke ,

faxxe

Fände ich auch sehr interessant, ich sehe leider nicht mal den Controller. Wie hast du es so weit bekommen, das er den Controller detected?

-

5 minutes ago, saakuwa said:

Moin, hätte eine kurze Frage, welche HW und FW vom Board sind bei dir vorhanden?

Bin auch alles durchgegangen und komme nicht über c3 und habe "nur" 2 HDDs und eine NVME dran, dabei komme ich auf ca. 27W+/-

Danke

Die Links stehen alle oben. Ich habe genau diese Hardware gekauft. Die BIOS Version vom Board habe ich leider nicht zur Hand. Unraid zeigt diese auch nicht im Dashboard an.

Ich glaube das wichtigste ist die Einstellungen von mgutt exakt im BIOS einzustellen und die Controller auf den richtigen Slots zu installieren.

-

On 4/28/2023 at 1:35 AM, mgutt said:

Ich versuche mich gerade an der 13ten Intel Generation. Ziel ist es ein günstiges Board mit 2.5G LAN und 4x SATA mit einer SATA Karte so zu erweiteren, dass das Setup trotzdem noch wenig Strom verbraucht (um überhaupt als Heimserver in Frage zu kommen). Das Ziel wäre ein Leerlaufverbrauch unterhalb von 10W.

Hardware:

Gigabyte B760M Gaming X DDR4

Intel i7-13700T

Samsung 16GB RAM DDR4 Modul

Samsung Evo Plus 2TB NVMe

Corsair RM550x (2021) Netzteil

Swissbit U-56n 4GB USB 3.1 Flash Drive

Samsung QVO 8TB SATA SSD

diverse SATA Karten zum Testen verfügbar (ASM1166 und JMB585, beide als PCIe und M.2 Karten)

BIOS-Anpassungen siehe unten

Statt powertop --auto-tune, setze ich die Tweaks manuell als Kommando ab (siehe powertop Thread)

NVMe

7,4 W

Dabei spielt es keine Rolle, ob die NVMe im CPU oder Chipsatz M.2 Slot steckt

C8

NVMe + ASM1166 PCIe X1 Karte (Slot 1 oder Slot 2) + SATA SSD

Die Karte wird weder im oberen (CPU), noch unteren PCIe Slot (Chipsatz) erkannt

15,4 W

C3

NVMe + JMB585 PCIe X4 Karte (Slot 1) + SATA SSD

18,2 W

C2

NVMe + JMB585 PCIe X4 Karte (Slot 1) + SATA SSD

13,4 W

C3

NVMe + ASM1166 M.2 Karte (Slot 2) + SATA SSD

9,8 W

C8 ("med_power_with_dipm" Tweak nur für "/sys/class/scsi_host/host[1-8]", ansonsten verliert die SATA SSD die Verbindung. Ich versuche die Tage ein Firmware-Update zu installieren, was dieses Problem beheben sollte)

NVMe + ASM1166 M.2 Karte adaptiert in 1. PCIe Slot + SATA SSD

16,3 W

C2

eigentlich hätte ich erwartet, dass die Karte nicht erkannt wird, wie im vorherigen Test mit der X1 Karte

NVMe + ASM1166 PCIe X4 Karte (Slot 1) + SATA SSD

ASM1166 Karte wurde erst nach Firmware-Update erkannt

16,3 W

C2

NVMe + ASM1166 PCIe X4 Karte (Slot 2) + SATA SSD

ASM1166 Karte wurde erst nach Firmware-Update erkannt

9.5 W

C8

Geänderte BIOS Einstellungen:

@mgutt Absolut Gold wert solche Posts! Ich habe deine Posts jetzt quer durchs Internet immer wieder zu Low Power Systemen gesehen und muss mich an dieser Stelle einmal bedanken! Vielen Dank für das ganz Experimentieren und die Leute, so wie mich, in die richtige Richtung schicken!

Ich kann mit meinem System folgendes zurückmelden:

Auf weniger werde ich mit den ganzen SSDs und Controllern wohl nicht kommen. 17 Drives in total, HDDs natürlich spun down. Aber 5 min nach Boot. Das Setup ist nun wie oben beschrieben.

Erfolg auf ganzer Linie, würde ich sagen!

PS: 2,5GbE funktioniert einwandfrei!

-

Yes. The last message before the error is "nothing to do here" from another amc mover job from hours before.

-

7 hours ago, Djoss said:

How do you reproduce this ?

I just restart the docker. After about a timespan of 8-24 hours it shuts down with this exact error again.

-

-

Ich nutze es für einen meiner Cache Arrays mit 4 SSDs im RAIDZ. Nutze aber den XFS von Unraid für meine 10HDDs, da dieser leichte Erweiterung und HDD Spin-Down ermöglicht. Das können TrueNAS oder Proxmox nicht oder nicht so gut/einfach. Darum bin ich noch bei Unraid. Habe aber inzwischen alle infrastrukturkritischen VMs und Container auf einen Mini PC mit Proxmox umgezogen, weil ich keine Lust mehr hatte, wenn Unraid mal wieder sponn ohne z.B. meine HomeAssistant VM und somit ohne Lichtsteuerung dazustehen

Aber wir weichen vom Thema des Threads ab! Danke erstmal an alle für den Input. Ich habe das MB und die Controller bestellt und werde die kommende Woche berichten!

-

Bisher war das System mit ZFS stabil, aber es gab immer wieder iowait Probleme. Wären die Vorteile von Unraid nicht mit dem guten Software Array und dem HDD Spindown würde ich wahrscheinlich auf Proxmox wechseln aufgrund der Stabilität...

Mal sehen, wie gut es funktioniert mit dem neuen Setup.

Gigabyte B760M Gaming X DDR4 Messung und SATA Erweiterung

in NAS/Server Eigenbau & Hardware

Posted

Ich bin immer noch auf 6.12.4. Daran liegt es wohl nicht. Aber wenn es dadurch nicht mehr zum Abmelden der Platten kommt, dann nehme ich die 2,5-3W hin.